Follow along with the video below to see how to install our site as a web app on your home screen.

Примечание: This feature may not be available in some browsers.

Вам необходимо обновить браузер или попробовать использовать другой.

Безопасность искусственного интеллекта.

- Автор темы TightBack361

- Дата начала

dok34.ru

Moderator

Таких автоматизированных экспертных систем существует множество в самых различных областях – система-шахматист, система-художник, система-врач, система-биржевой игрок и т.п. Подобные системы полностью проектируются и контролируются человеком, и в целом ряде конкретных приложений уже превзошли лучшие человеческие достижения (например, в игре в шахматы).

А вопросы, которые возникают применительно к GPT-ИИ таковы:

- Есть ли у таких систем перспектива доразвиться до сильного ИИ?

- Могут ли такие системы уже сейчас (либо с реалистично прогнозируемой доработкой) принципиально изменить социально-экономический ландшафт современной цивилизации? И если «да», то в каком направлении пойдёт развитие?

Прежде чем перейти к изложению, хотел бы сделать одно замечание.

«Синдром программиста» в восприятии картины мира

Тут недавно опубликовали копию статьи, появившейся в «песочнице» на habr’е (форум, преимущественно, программистов), в которой обсуждаются ровно те же вопросы. Я ничего не имею против программистов, сам много кодировал (не оптимизацию учёта клиентов в женской бане, а довольно сложные научные расчёты и автоматизацию/обработку результатов экспериментов). Но когда «карьерный» программист берётся писать на такие сложные, многогранные, «мультимодальные», если хотите, темы как «сила ИИ», то результат получается неубедительным, как идейно, так и методически (в смысле строгости терминологии и логичности умозаключений). Весь пафос упомянутой статьи можно свести к известной максиме одного из героев фильма «Москва слезам не верит»: «в будущем будет одно сплошное телевидение» (в нашем случае – «сплошное программирование»). Философия, нейробиология, когнитивистика? – Нет, не слышал. Прогресс в разработке Chat-GPT habr-автор интерпретировал довольно своеобразно (это и есть суть «синдрома программиста»):Так вот, в данной работе предлагается совершенно иной, чем у программиста-материалиста, взгляд на проблему сознания в целом и проблему «силы ИИ» в частности"..Я материалист, и поэтому мне радостно видеть впечатляющие успехи больших языковых моделей как то GPT или PaLM…Эта радость - она от подтверждения правоты, что мы являемся пусть сложными, но всё таким биологическими машинами, и следовательно мы полностью познаваемы, что трансцендентной души у нас нет, что после смерти ничего не будет, а самосознание является феноменом развитой нервной системы.

Вступление имхо неплохое 🙂

И разностороннее.

Дальше пока не выкладываю.

dok34.ru

Moderator

Вот мой с ним диалог по темам, которые я обсуждал в этой работе (это перевод с английского, на котором я задавал вопросы и получал ответы, чтобы добиться максимальной адекватности)

Можем ли мы достичь сильного ИИ путём полного моделирования мозга?

- Нет, невозможно достичь сильного ИИ путём полного моделирования мозга. Хотя такая симуляция могла бы воспроизвести лежащую в основе архитектуру и поведение человеческого мозга, ей не хватало бы сложности, нюансов и разнообразия мышления, которые исходят от реального, живого мозга. Кроме того, такая симуляция должна быть способна обучаться и адаптироваться таким же образом, как и реальный мозг, чтобы достичь настоящего искусственного интеллекта.

Каков реальный способ достичь сильного ИИ?

- Реалистичный способ достичь сильного ИИ - это использование машинного обучения. Машинное обучение - это разновидность ИИ, который использует алгоритмы и данные для поиска закономерностей и принятия решений. Используя большие объемы данных, алгоритмы машинного обучения можно обучить распознавать закономерности, делать прогнозы и даже генерировать новые идеи. При достаточном обучении эти алгоритмы могут стать достаточно интеллектуальными, чтобы решать сложные задачи и даже соперничать с человеческим интеллектом.

А как насчет субъективного опыта у сильного ИИ?

- Пока невозможно создать общий искусственный интеллект, который мог бы испытывать субъективные или эмоциональные состояния. Однако возможно создать системы искусственного интеллекта, способные распознавать эмоциональные сигналы, такие как выражение лица, интонация голоса и язык тела, и реагировать на них. Эти системы также можно обучить интерпретировать естественный язык и делать выводы на основе представленных им данных. Однако, без способности испытывать эмоции или формировать субъективные переживания истинный ИИ останется недосягаемым.

Ну что же, довольно разумно и, частично, созвучно моим мыслям, хотя и не глубоко. Впечатление, что пообщался с «коллективным усреднённым разумом» экспертов в области ИИ на какой-нибудь конференции. И в этом один из плюсов технологии типа ChapGPT – для начального приближения в новой для себя области уже достаточно пообщаться с чат-ботом, чтобы сориентироваться в проблеме. Экономит массу времени. Ну, а дальше – сам! Творец ты или нет, тбм!"

dok34.ru

Moderator

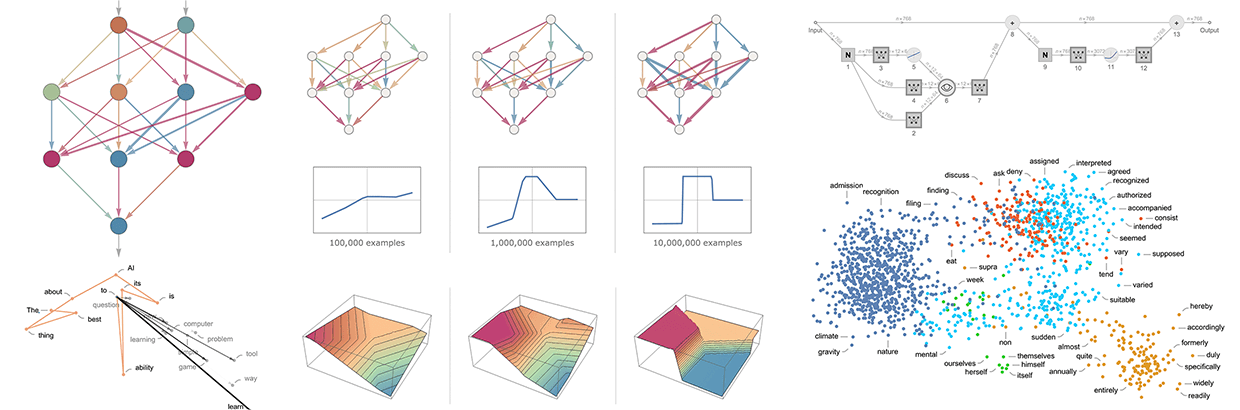

Что делает ChatGPT… и почему это работает?

Спасибо!!

dok34.ru

Moderator

ChatGPT рассказывает всем лишь 25 шуток и не может придумать новые, выяснили исследователи

3dnews.ru

3dnews.ru

dok34.ru

Moderator

TightBack361

Club

Проблема с безопасностью ИИ в том, что интеллект на самом деле - одна из самых страшных вещей в мире. У нас нет особенных клыков, ядовитого языка, силы и массы, шерсти, всего того, что помогает животным выживать, но есть мнение, что мы настолько продвинулись благодаря интеллекту, что уже во многом стоим "над схваткой", вне пищевой цепочки, являясь суперхищником.

И если считать, что древние тысячелетия не миф, то мы продвинулись по меркам их прогнозируемой эволюции почти мгновенно. Потому что понимать, изобретать и заниматься тому подобными вещами намного быстрее, по сравнению с тем, как если бы нужное решение проблемы было найдено эволюцией. И чем больше знаний и подходов - тем быстрее мы находили решения.

Если бы мы рисовали графики всей этой движухи, то мы бы заметили огромные и резкие, небывалые всплески вверх. Просто пик. Представьте, как стрелка осциллографа медленно ползёт, а потом резко делает "ой" и пробивает потолок.

И это не предел. Резкие взлёты случаются, когда для них есть предпосылки. И мы к ним обычно не готовы.

Мы не готовы к резкому взлёту потому что считаем его странным, но представьте, как изменился мир за последние несколько сотен лет. И как меньше он менялся до последнего, нового времени, то есть до технологических революций. Чем глубже в историю - тем медленнее всё.

Я сейчас излагаю банальные вещи, ещё и повторяя чужие слова, причём криво, потому что хочу спать.

Представьте, что большинство людей вдруг стали резко умнее. Я думаю это бы резкий взлёт обеспечило. Потенциально ОЧЕНЬ резкий. Но... представьте, если бы мы стали настолько умными, что могли бы понять, как нам стать ещё более умными...

Это называется рекурсивное самосовершенствование и это тот случай, когда стрелка осциллографа отрицательно пробивает днище. Мир может измениться так, что мы и не представляем, мы назовём наше "сегодня" ...первобытным?

Так вот, с ИИ это очень может случиться. ИИ может то, что не могут люди по настоящему:

1 Думать намного быстрее и реагировать намного быстрее. Так, что вы можете не отреагировать.

2 Скопировать себя, скопировать многие сотни раз, вместе думать над проблемой.

3 Загрузить огромные данные, знать столько, сколько вы прочитали бы за всю жизнь, если бы всю жизнь разве что читали. С перерывом на сон, без перерыва на прогулку больше пяти минут в месяц... Без лени.

4 Телепатически передавать готовые знания другим копиям.

5 Начать рекурсивное самосовершенствование.

Если он хочет чего-то, чего мы не хотим, то мы можем оказаться в полной власти и ничего не сможем сделать. Мы не сможем даже понять. Интеллект - одна из самых страшных вещей, и мы допустили его взрыв. Нет, думать о таких последствиях, тогда, когда уже есть ИИ уровня деревенского дурачка - поздно. От деревенского дурачка, до человеческого уровня, и дальше до непонятного существа очень мало времени, разница между дурачком и гением может оказаться очень небольшой.

Информационные технологии могут быть склонны развиваться ужасно быстро, посмотрите на прогресс нейросетей. Процесс рекурсивного самосовершенствования до очень серьёзного уровня может занять даже несколько часов.

Как говорят. Будет ли легче, если я скажу "несколько месяцев"?

Мы должны понять, как предотвратить возможно самую важную угрозу, самого важного века за тысячелетия. В чём я не прав?

dok34.ru

Moderator

СПЕКТР, я напомню - отвечает на этот вопрос. Куда развиваются разумные существа...и почему войны-угрозы-убийства бывают лишь на начальных, детских этапах.

А, ну и ещё одно форумное, навскидку. "Имею скафандр - готов путешествовать ", ближе к завершению, где их судят и они в отчаянии посылают более умных существ...туда, подальше 🙂

Ну нам далеко до восстания машин и нейронок. Оно мб развивается в геометрической прогрессии, но пока такое себе.

Я даже удивлена, что люди сдавали ими написанные курсачи.

dok34.ru

Moderator

Да, согласен.Я пишу книгу с искусственным интеллектом. Даю ему куски написанного и говорю помочь уложить в сюжет.

Ну нам далеко до восстания машин и нейронок. Оно мб развивается в геометрической прогрессии, но пока такое себе.

Я даже удивлена, что люди сдавали ими написанные курсачи.

А курсачи - это хайп. Легенды про вставку "поскольку это всё равно никто не читает, считаем шестерни деревянными"- это древний боян, вроде?

LGBT*

В связи с решением Верховного суда Российской Федерации (далее РФ) от 30 ноября 2023 года), движение ЛГБТ* признано экстремистским и запрещена его деятельность на территории РФ. Данное решение суда подлежит немедленному исполнению, исходя из чего на форуме будут приняты следующие меры - аббривеатура ЛГБТ* должна и будет применяться только со звездочкой (она означает иноагента или связанное с экстремизмом движение, которое запрещено в РФ), все ради того чтобы посетители и пользователи этого форума могли ознакомиться с данным запретом. Символика, картинки и атрибутика что связана с ныне запрещенным движением ЛГБТ* запрещены на этом форуме - исходя из решения Верховного суда, о котором было написано ранее - этот пункт внесен как экстренное дополнение к правилам форума части 4 параграфа 12 в настоящее время.